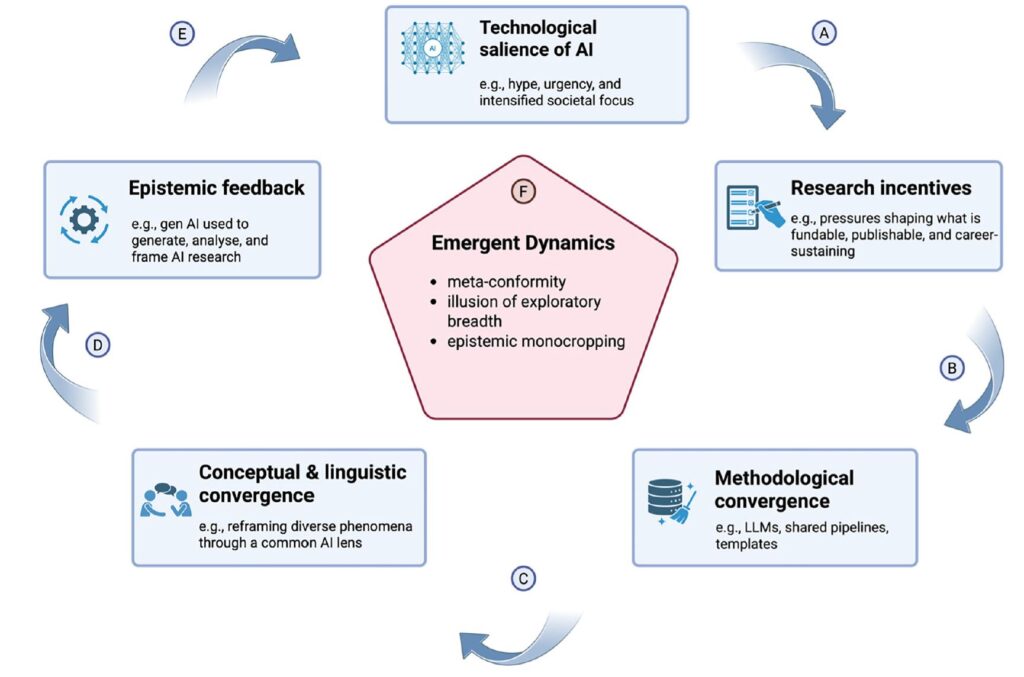

Es ist nur natürlich, dass jeder Einzelne, Organisationen und Öffentliche Verwaltungen ausprobieren, was mit Künstlicher Intelligenz (GenAI) möglich ist. Im wissenschaftlichen Umfeld wundere ich mich allerdings immer wieder darüber, wie unkritisch GenAI eingesetzt wird, wodurch die Kriterien wissenschaftlicher Arbeit konterkariert werden. Warum ist das so? Eine ausführlich Begründung habe ich im aktuellen OECD Report gefunden. Dabei geht es hier speziell um die Reproduzierbarkeit als Säule wissenschaftlichen Arbeitens geht.

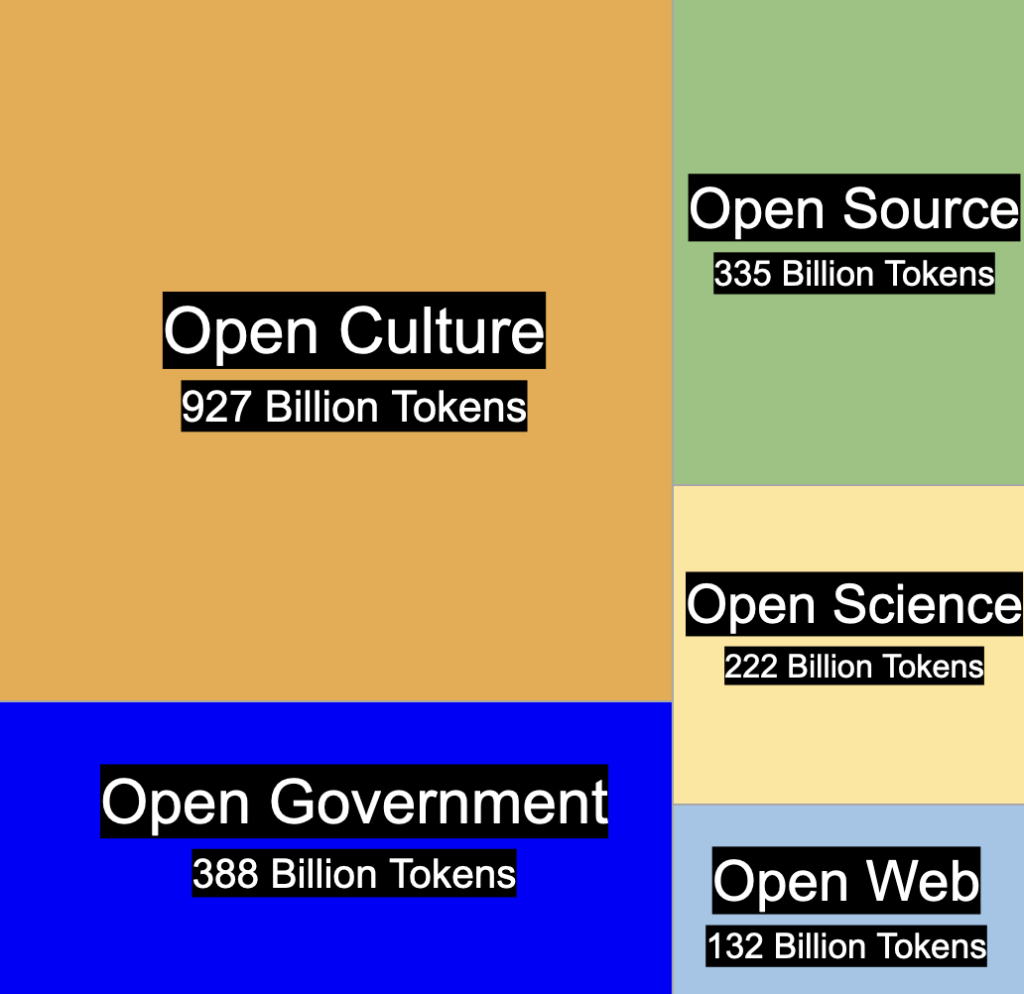

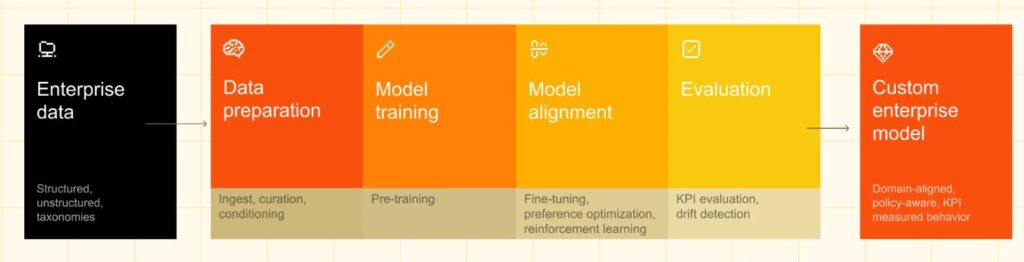

Reproducibility is a pillar of scientific operations. To be accepted by the scientific community, results must (usually) be verifiable, and reproducible by others. One condition for reproducibility is full disclosure of the methods and data that led to the conclusion, meaning transparency and accessibility. From this perspective, GenAI models do not meet scientific criteria. First, the most popular models of GenAI are “black boxes”, as neither their weights (the parameters that define a neural network) nor their training data are publicised. Thus, disentangling the contribution of the data and the contribution of various components of the model is difficult in any scientific result coming from such a model. This comes from the very nature of neural networks: knowledge is distributed, hence difficult to localise. As GenAI models have a random component at their core, some results might not be robust. In addition, access to the training data can be limited due to the proprietary nature of many GenAI models: one example is the “AI Structural Biology Consortium”, a follow-up to AlphaFold-3, an ongoing project which makes use of data owned by pharmaceutical companies, which is secret and will remain secret (Callaway, 2025). Currently, solutions for access include open weights (e.g. Llama) and open source (including access to training data). The importance of openness was demonstrated by AlphaFold2, as the disclosure of its code and data triggered a series of initiatives refining the tool (Saplakoglu, 2024). Openness is essential to the cumulative progress at the core of science“ (OECD Digital Education Report 2026).

Am Beispiel von Pharmaunternehmen wird deutlich, dass es gerade in sensiblen Branchen wichtig ist, offene KI-Modelle zu nutzen. Offenheit ist: „Offenheit ist für den kumulativen Fortschritt im Kern der Wissenschaft unerlässlich“ (ebd.). Siehe dazu auch

Open Source AI: Besser für einzelne Personen, Organisationen und demokratische Gesellschaften

In Zeiten des Hypes um Künstliche Intelligenz kann Akademische Integrität nicht schaden