In der heutigen Intelligenzdiskussion gibt es viele Facetten. Eine davon ist beispielsweise der Vergleich von Künstlicher Intelligenz mit dem Intelligenz-Quotienten (IQ). Dass dieser Vergleich möglicherweise ein Kategorienfehler ist, hatte ich schon in dem Beitrag Künstliche Intelligenz – Menschliche Kompetenzen: Anmerkungen zu möglichen Kategorienfehler erläutert.

In diesem Blogbeitrag möchte ich nun die Überlegungen für einen Intelligenz-Quotienten (IQ) und mögliche Kritikpunkte daran erläutern.

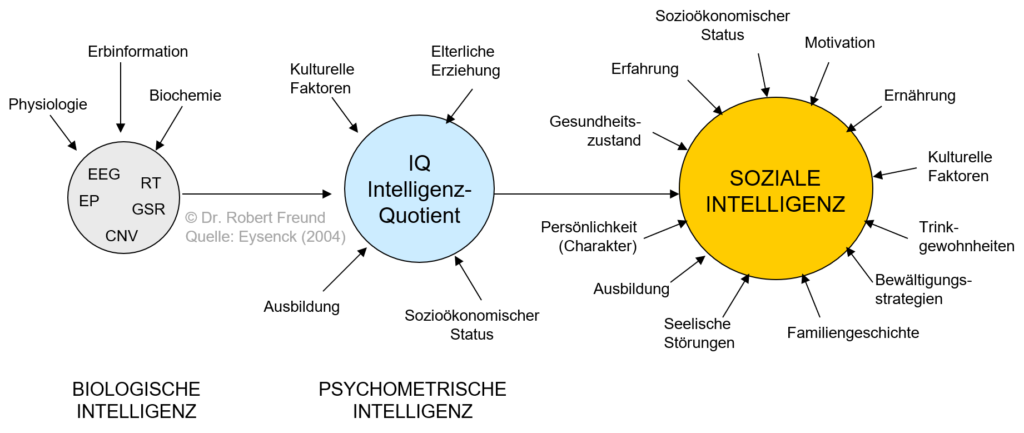

Wie der Abbildung zu entnehmen ist, bezieht sich der Intelligenz-Quotient (IQ), der als Psychometrische Intelligenz bezeichnet werden kann, auch darauf, dass diese aus der Biologischen Intelligenz hervorgeht. Eysenck, ein Vertreter der Psychometrischen Intelligenz, deutet damit auf den biologischen Charakter und den in den menschlichen Genen vorgegebenen Teil von Intelligenz hin. Der von der Psychometrischen Intelligenz verwendete Intelligenzbegriff basiert konsequenterweise auf diesen Annahmen:

„Unser Begriff „Intelligenz“ leitet sich von den lateinischen Wörtern intelligentia und ingenium her. Jenes bedeutet in Ciceros Verwendungsweise in etwa „Begreifen“ und „Wissen“, dieses soviel wie „natürliche Veranlagung“ oder Begabung“. Die zwei Bedeutungskomponenten sind dem Begriff „Intelligenz“ bis heute eigen geblieben“ (Eysenck 2004).

Eine Erweiterung der Psychometrischen Intelligenz (IQ) in Richtung einer Sozialen Intelligenz lehnt Eysenck kategorisch ab, und begründet das wie folgt: „Das Konzept der sozialen oder praktischen Intelligenz ist eindeutig viel zu komplex, als dass es irgendeinen wissenschaftlichen Wert haben könnte; zum Wesen der Wissenschaft gehört es ja auch und gerade, komplexe Konzepte auf einfache, elementarere zu reduzieren“ (Eysenck 2004). Die Vereinfachung komplexer Sachverhalte ist heute allerdings unangemessen.

Im Gegensatz dazu gibt es immer mehr Hinweise darauf, Intelligenz weniger reduktionistisch und besser als komplexes System zu verstehen, was eine deutlich bessere Passung mit dem heute üblichen Umgang mit Komplexität haben würde. Intelligenz-Theorien, die so einem Anspruch gerecht werden, sind:

„Die Triarchische Theorie (vgl. Sternberg 1985a/1985b) und die Multiple Intelligenzen Theorie (vgl. Gardner 1983/1993) scheinen geeignet zu sein, wenn es um eine notwendige Erweiterung des Intelligenzbegriffs geht (vgl. Siebert/Seidel 2000:48), da beide Theorien als Systemmodelle bezeichnet werden können, die „auch externe Aspekte des Erlebens und Denkens [mit einbeziehen, und] (…) Intelligenz als komplexes System betrachten“ (Schulze et al. 2006:15)“ (zitiert in Freund 2011).

Siehe dazu etwas ausführlicher Intelligenztheorie: Anmerkungen zu Sternbergs Triarchischen Theorie und Gardners Multiple Intelligenzen Theorie.