KI-Agenten sind aktuell gefühlt überall. Natürlich bieten die proprietären Modelle wie ChatGPT, Gemini, Grok etc. viele Möglichkeiten an, solche KI-Agenten zu erstellen und zu nutzen. Wie Sie als Leser unseres Blogs wissen, tentieren wir allerdings dazu, Open Source AI zu nutzen, gerade wenn es um eigene, spezielle Expertise, oder unternehmensspezifisches Wissen in Innovationsprozessen geht.

Neben den von uns schon beschriebenen Möglichkeiten von Langflow und Ollama, möchten wir Ihnen eine weitere Alternative vorstellen, eigene KI-Agenten zu nutzen, und dabei unterschiedliche LLMs einzubinden.

„Smolagents is a minimalist AI agent framework developed by the Hugging Face team, crafted to enable developers to deploy robust agents with just a few lines of code. Embracing simplicity and efficiency, smolagents empowers large language models (LLMs) to interact seamlessly with the real world“ (Source: https://smolagents.org/de/).

Das Team von Hugging Face bietet hier eine minimalistische Möglichkeit, auf Open Source Basis KI-Agenten zu entwickeln, und der Community in einem Repository zur Verfügung zu stellen (Best Smolagents in Hugging Face).

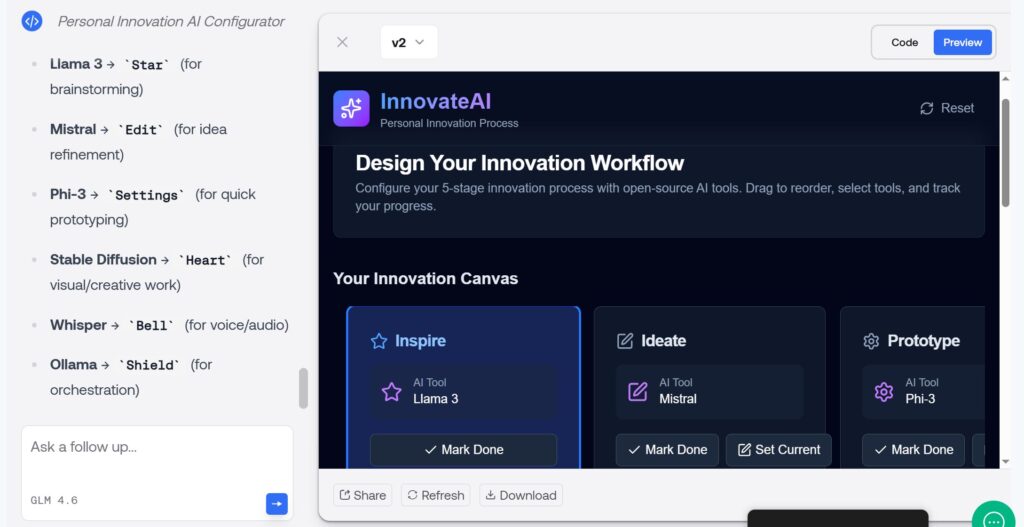

Es ist interessant zu sehen, wie einfach man seine Idee in einem ersten KI-Agenten umsetzen kann. In dem folgenden Beispiel habe ich versucht, einen persönlichen Innovationsprozess abzubilden. In jedem Prozessschritt wollte ich ein anderes Open Source KI-Modell einsetzen.

In der Abbildung sind erste Prozessschritte für die Entwicklung von Innovationen zu sehen: Inspire mit Llama 3, Ideate mit Mistral, Prototype mit Phi 3 etc. Die jeweiligen LLM kann ich auswählen und testen. Das ging sehr schnell und war super einfach.

Probieren Sie es doch auch einmal aus!