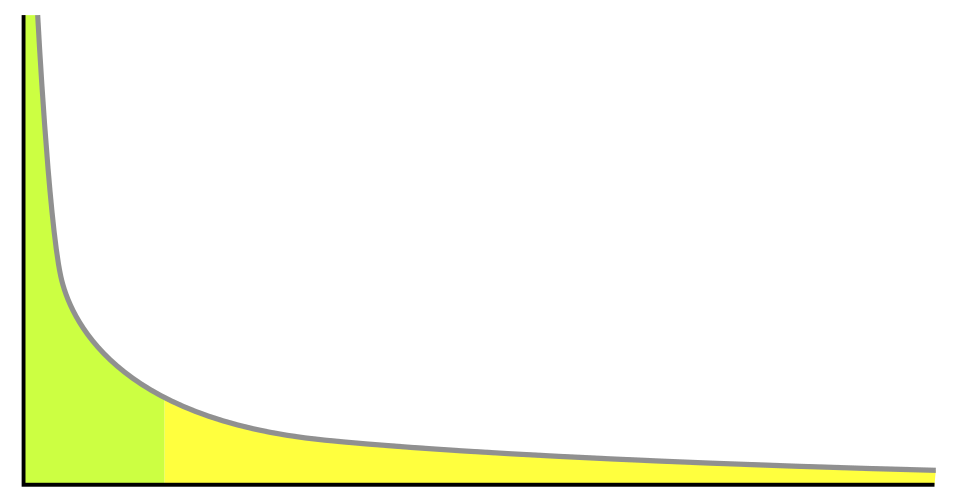

Seit der Veröffentlichung von The long tail (Chris Anderson 2004) wird diskutiert, ob sein Ansatz heute noch stimmt. Anderson stellte dar, dass es bei digitalisierten Produkten möglich ist, immer mehr Nischen zu bedienen. Wenn man dabei die Grafik zu den bekannten ABC-Produkten im Verkauf etwas abstrahiert, kommt so eine Grafik heraus, wie Sie in der Abbildung zu sehen ist. In der Zwischenzeit gibt es allerdings durchaus Kritik an dem Ansatz.

»The original idea of the long tail, as described by Chris Anderson in his book of the same name, was that a single manufacturer would take care of all the variants along the long tail of a product segment. But the long tail of products is also a long tail of niche markets served by different manufacturers with different business models« (Piller & Euchner, 2024).

Piller und Euchner weisen also darauf hin, dass es nicht alleine ein Unternehmen sein muss, dass den long tail bedient, sondern es können auch unterschiedliche Unternehmen mit verschiedenen Geschäftsmodellen sein.

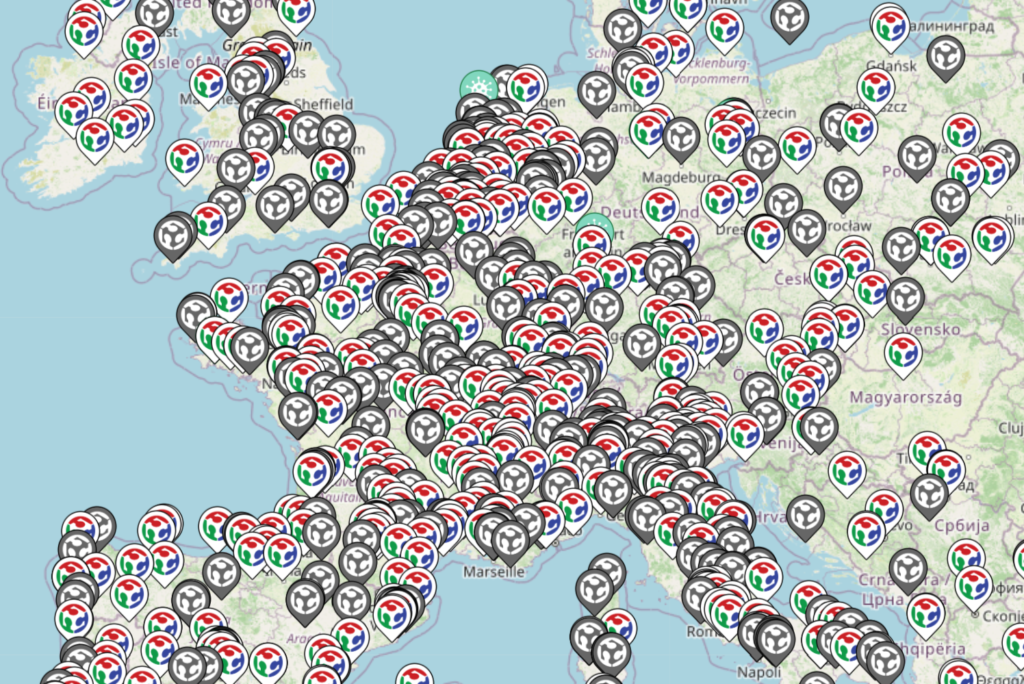

Diese Erweiterung ist schon hilfreich, doch geht es mir nicht weit genug. Warum müssen es Unternehmen mit ihren Geschäftsmodellen sein, die die bisher nicht befriedigten Wünsche von Usern bedienen? Heute können es auch die User selbst sein, die ihre Produkte herstellen – mit Hilfe moderner Technologien in Repair Cafés, FabLabs, Maker Spaces, Communities usw. (User Innovation). Siehe dazu ausführlicher meine Beiträge zum Thema.

Um die verschiedenen Schritte zur Herstellung des eigenen Produkts einfach, kostengünstig und selbst durchzuführen, bietet sich heute die Unterstützung durch Künstliche Intelligenz an.

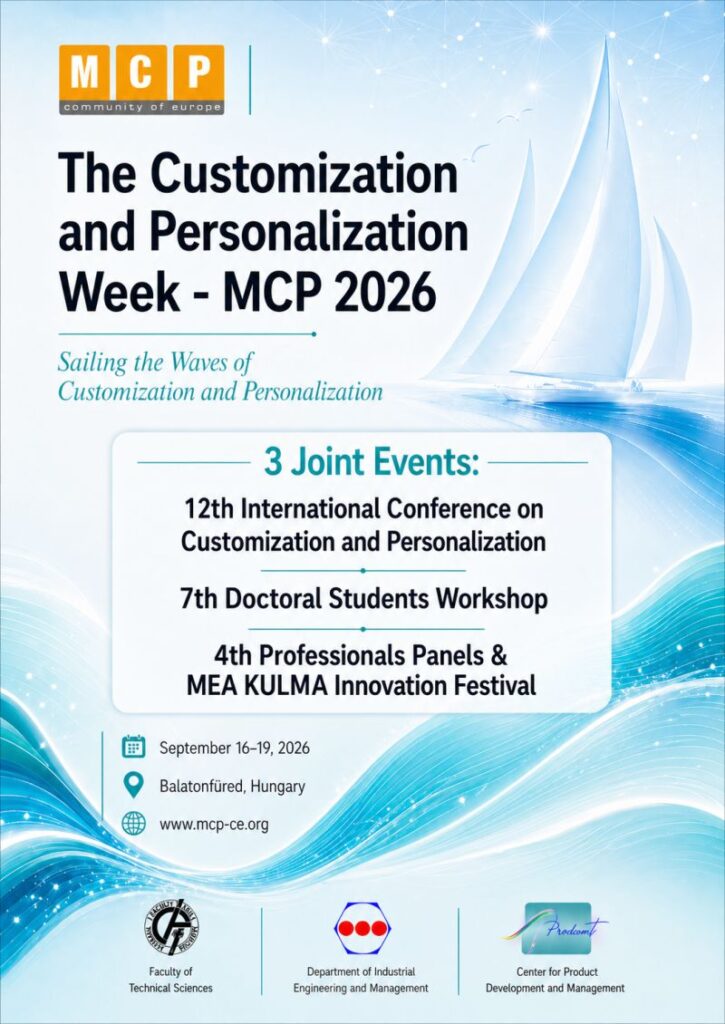

Auf der internationalen Konferenz MCP 2026, die vom 16.-19.09.2026 in Balatonfüred, (Ungarn) stattfindet, werde ich in einem meiner Paper auf diese Entwicklung eingehen:

Open-Source AI for Open User Innovation: Designing a Personal Fabrication Framework

Digital Sovereignty and Open-Source AI: The European Way for Innovative SMEs