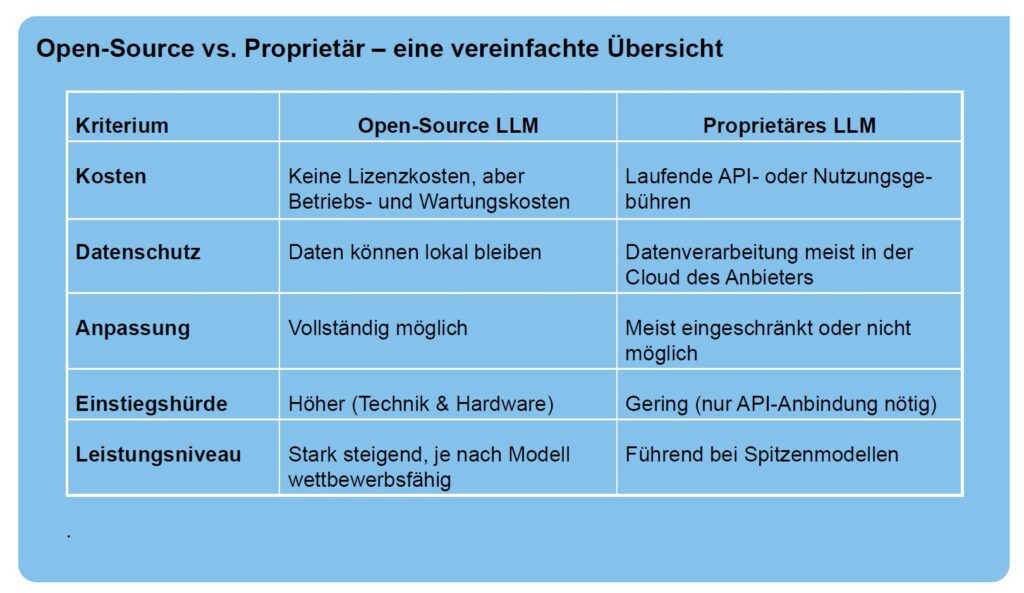

Wie die proprietären KI-Modelle wie ChatGPT, Gemini, Anthropic, Grok, Claude etc. funktionieren, ist oft nicht transparent, wodurch sich letztendlich auch kein wirkliches Vertrauen in diese Systeme aufbauen kann – it all starts with trust.

Es ist daher nur konsequent, wenn immer mehr Einzelpersonen, Unternehmen und Öffentliche Verwaltungen auf offene und transparente KI-Modelle setzen. In dem Zusammenhang gibt es auch ein Forschungsfeld, das sich mit den damit einhergehenden Fragestellungen befasst.

„Explainable AI (XAI) – Forschungs- und Anwendungsfeld der Künstlichen Intelligenz, das Methoden entwickelt, um Entscheidungen, Vorhersagen oder generierte Inhalte von KI-Systemen transparent, nachvollziehbar und überprüfbar zu machen. Ziel ist es, Vertrauen zu schaffen und Fehlentscheidungen zu vermeiden.“ (Mittelstand Digital Fokus Mensch (2026): Digitale Souveränität als Basis für sichere KI-Anwendungen).

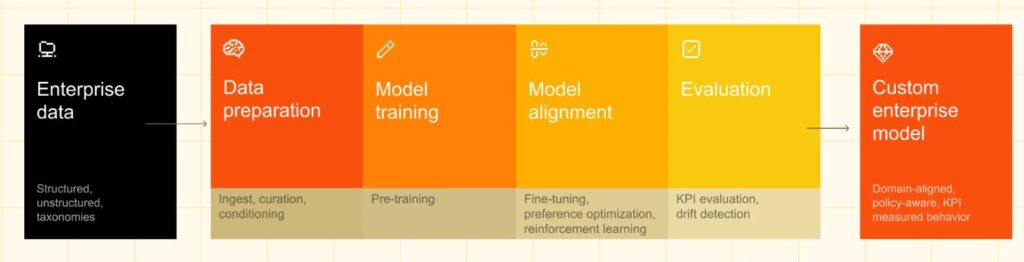

Es stellt sich dabei natürlich gleich die Frage, was das z.B. für Kleine und Mittlere Unternehmen (KMU) in der Praxis bedeuten kann. „Gerade in geschäftskritischen Anwendungen ist Vertrauen in die Funktionsweise von KI-Systemen unerlässlich“ (ebd.). Solche Anwendungen sind ganz besonders Innovationsprozesse. Da sich gerade der deutsche Mittelstand innovativ ausrichtet, ja ausrichten muss, kommt Explainable AI (XAI) ein große Bedeutung zu.

Das Fraunhofer Institut hat dazu eine eXplainable Artificial Intelligence (XAI)-Toolbox entwickelt: „Das heißt, die Toolbox kann z. B. zur Datenanalyse, zum Debugging und zur Erklärung der Vorhersage eines beliebigen Black-Box-Modells eingesetzt werden“ (ebd.).