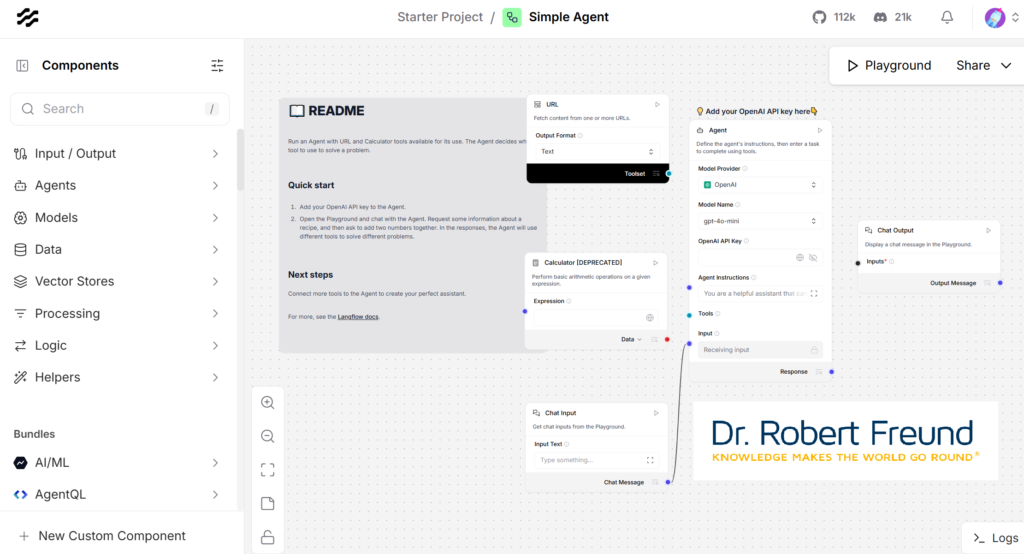

Die aktuelle Diskussion zu Künstlicher Intelligenz befasst sich u.a. mit den Möglichkeiten generativer Künstlicher Intelligenz (GenAI) und den Entwicklungen bei KI-Agenten (AI Agents). KI-Agenten können in Zukunft viele Tätigkeiten/Jobs in Organisationen übernehmen, und so deren Effektivität und Effizienz steigern.

Solche Entwicklungen sind allerdings nicht alleine auf Organisationen begrenzt. Auf der individuellen, persönlichen Ebene entwickeln sich KI-Agenten immer mehr zu persönlichen Agenten, oder sogar zu Personal AI Twins:

„Personal AI Twins represent a profound shift from generic to deeply personalized agents. Unlike today´s systems that may maintain the memory of past interactions but remain fundamentally the same for all users, true AI twins will deeply internalize an individual´s thinking patterns, values, communication style, and domain expertise“ (Bornet et al. 2025).

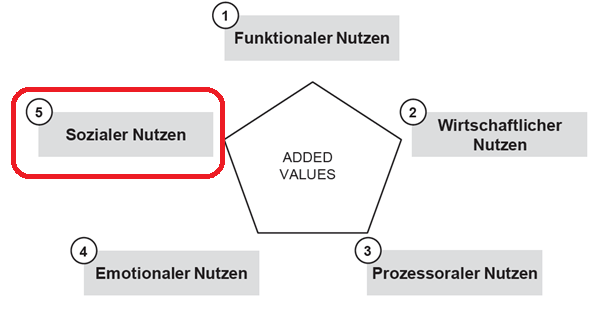

Die hier angesprochene Entwicklung von generischen KI-Agenten zu personalisierten KI-Agenten (personal ai twins) ist bemerkenswert. Es stellt sich natürlich gleich die Frage, ob eine Person solche Personal AI Twins nur für ihre Arbeit, oder auch für alle ihre Aktivitäten nutzen möchte. Dabei kommt es immer wieder zu Überschneidungen zwischen der beruflichen Domäne und den privaten Kontexten.

Möglicherweise können einzelne Personen in Zukunft mit Hilfe von Personalized AI Twins ihre eigenen Ideen besser selbst entwickeln oder sogar als Innovationen in den Markt bringen. Dabei empfiehlt sich aus meiner Sicht die Nutzung von Open Source AI – ganz im Sinne einer Digitalen Souveränität und im Sinne von Open User Innovation nach Eric von Hippel. Siehe dazu auch

Eric von Hippel (2017): Free Innovation

Von Democratizing Innovation zu Free Innovation