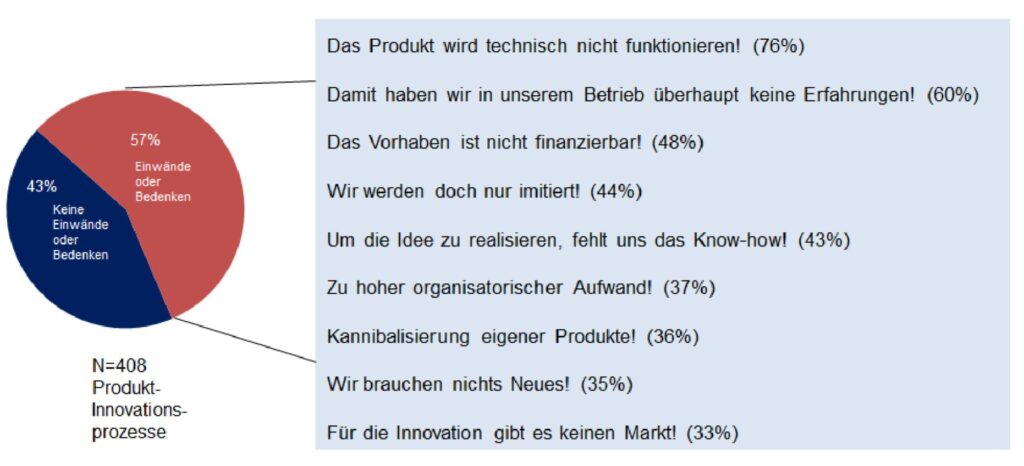

In der Abbildung sind beispielhaft Bedenken und Einwände zu sehen, die so – oder so ähnlich – zu hören sind, wenn Produktinnovationen angestoßen werden. Ich bin sicher, Sie haben solche Äußerungen auch schon oft gehört, sogar schon bei den ersten Ideen.

„Eine neue Idee ist zerbrechlich. Sie kann durch höhnisches Lächeln oder Gähnen getötet werden. Sie kann durch einen Witz erdolcht oder durch Stirnrunzeln bei der falschen Person vor lauter Sorgen in den Tod getrieben werden“ Charles Brower, Ex-CEO von BBDO.

Es scheint normal zu sein, neue Ideen und Innovationen erst einmal abzulehnen. Dieses Verhalten kann ganz gut mit dem relativ stabilen Deutungsmuster von Erwachsenen erklärt werden, das transformiert werden muss. Solche Prozesse findet man als Kernelement in der Erwachsenenbildung, wo Lernen als Transformation von Deutungsmustern verstanden wird.

Deutunslernen: Transformation von subjektiven Deutungen und Konstrukten durch die Initiierung von selbstorganisierten Suchbewegungen und eigenständigen Aneignungsprozessen der Erwachsenen – vgl. dazu Arnold, R. (1995): Deutungslernen in der Erwachsenenbildung. Grundlinien und Illustrationen zu einem konstruktivistischen Lernbegriff, in Zeitschrift für Pädagogik 42 (1996) 5, S. 719-730 | PDF.

Neben den bekannten Ansätzen, mit Widerständen im Innovationsprozess umzugehen (z.B. mit dem Promotorenmodell von Witte), ist die Perspektive der Erwachsenenbildung im Innovationsprozess für viele neu, und wird damit selbst zu einem innovativen Ansatz.

Siehe dazu auch Digitale und ökologische Transformation bedeutet auch eine Transformation von Deutungsmustern.