Über Open Data und Open Source Ai habe ich in dem Beitrag Open Data and Open Source AI – a perfect match geschrieben. Eine besondere Rolle nimmt in dem Zusammenhang Common Corpus ein,

In dem Beitrag Langlait et al (2024): Releasing the largest multilingual open pretraining dataset vom 14.11.2024 auf Huggingface wird das Konzept und das Alleinstellungsmerkmal von Common Corpus als Teil der AI Alliance Open Trusted Data Initiative vorgestellt.

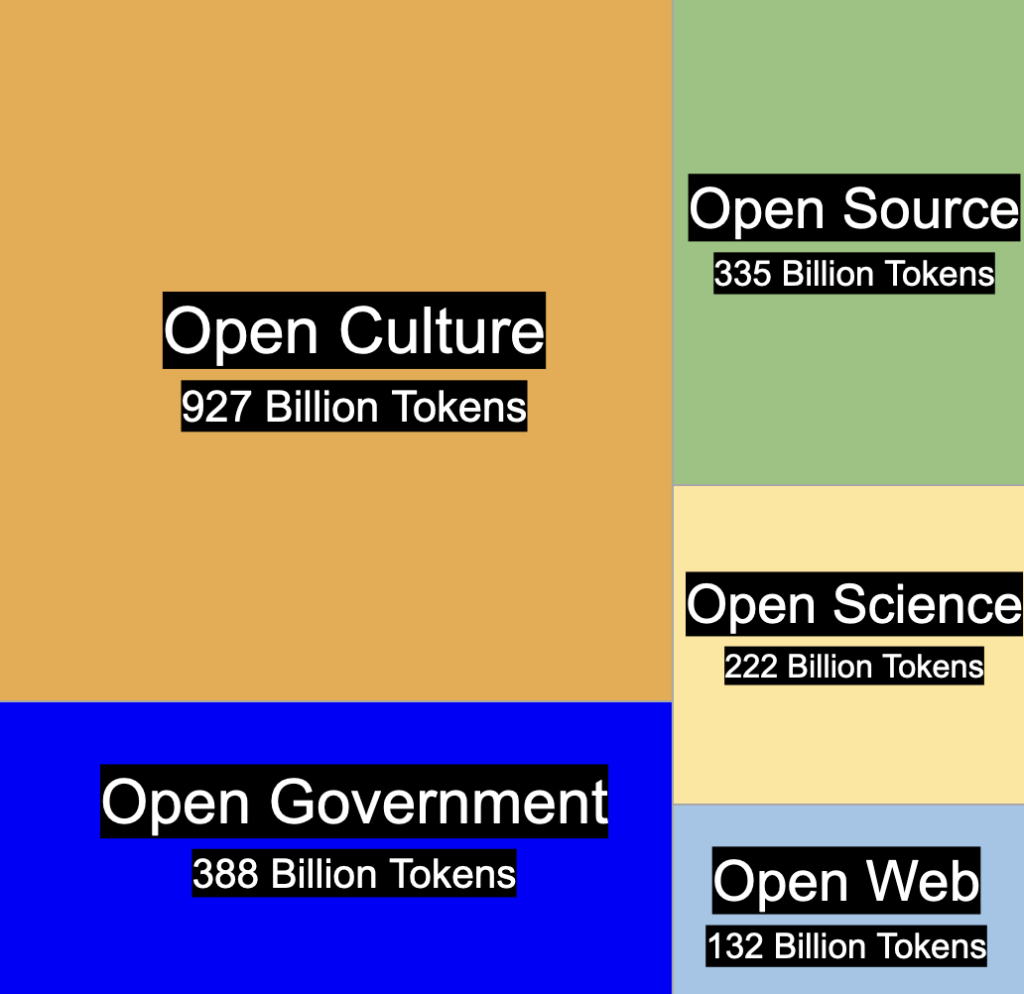

„Many have claimed that training large language models requires copyrighted data, making truly open AI development impossible. Today, Pleias is proving otherwise with the release of Common Corpus (part of the AI Alliance Open Trusted Data Initiative)—the largest fully open multilingual dataset for training LLMs, containing over 2 trillion tokens of permissibly licensed content with provenance information (2,003,039,184,047 tokens)“ (Source).

In der Zwischenzeit wurde Common Corpus schon mehr als 1 Millionen Mal heruntergeladen. Der starke Anstieg der Downloads zeigt eine relative Verschiebung auf dem KI-Markt, denn immer mehr Marktteilnehmer suchen nach Open Data, die sie frei nutzen können.

„Open-Source-Datensätze wie das Common Corpus bieten hier eine Lösung. Sie ermöglichen es Forschern und Unternehmen, auf eine breite Palette von Daten zuzugreifen, ohne sich über komplexe Lizenzfragen oder potenzielle Urheberrechtsverletzungen Gedanken machen zu müssen“ ( Common Corpus übertrifft eine Million Downloads und hebt Bedeutung von Open Data für KI hervor, Mindverse vom 12.03.2026).

Langsam aber sicher wollen immer mehr KI-Nutzer Künstliche Intelligenz gesellschaftlich verantwortungsvoll nutzen – ganz im Sinne einer Digitalen Souveränität.