Obwohl viele Menschen und Unternehmen wissen, dass es in der heutigen, stark vernetzten Welt kaum möglich ist, die Zukunft vorherzusagen, versuchen es doch immer wieder einige. Beispielsweise die Tech-Konzerne aus dem Silicon Valley, die fast täglich mit Visionen oder Stories versuchen, Anleger zu beeinflussen. Viele Voraussagen/Ziele sind nicht eingetroffen.

Die New York Times hat zum Beispiel 602 Ziele von Elon Musk untersucht und festgestellt, dass er nur 19% davon wirklich erreicht hat. Dennoch hat Elon Musk alleine durch das Formulieren von (seinen) Zielen erreicht, dass sich viele mit (seinen) Zielen befasst haben. Die Erkenntnis solcher Analysen ist nicht neu, denn viele Vorhersagen haben auch schon in der Vergangenheit nicht gestimmt. Aktuell wollen einige wieder Wissen, wie sich Künstliche Intelligenz als Innovation entwickeln wird und formulieren entsprechende Ziele – auch hier ist Vorsicht geboten. Dazu habe ich einen Beitrag gefunden, der die Situation gut beschreibt:

„The future of innovation is likely in hybrid models that combine the strengths of AI-driven processes with human-led OI. Such models could leverage AI’s capacity for rapid ideation and data processing while harnessing human creativity, intuition, and ethical judgment. For example, AI could generate initial ideas or prototypes, which human collaborators then refine, contextualize, and ethically evaluate through OI platforms. An optimist would argue that this approach might further democratize innovation by allowing a wider range of participants to contribute meaningfully, even if they lack deep technical expertise. A pessimist might be concerned about centralized power, diminishing creativity, lack of agency, and IP issues. In the end, whether you’re an optimist or a pessimist, one thing is certain: the future of innovation will be dynamic, interactive, and unpredictable“ (Holgersson et al., 2024).

Als Optimist gehe ich davon aus, dass wir Innovationen wie die Künstliche Intelligenz stärker demokratisieren sollten und auch werden – siehe dazu auch Von Democratizing Innovation zu Free Innovation.

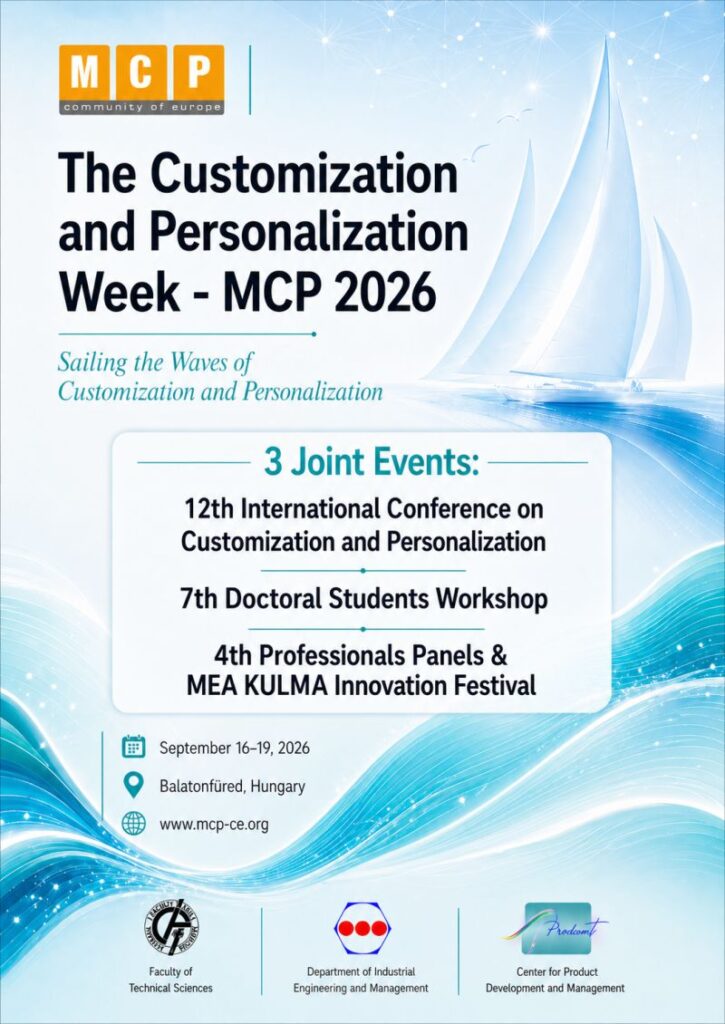

Auf der internationalen Konferenz MCP 2026, die vom 16.-19.09.2026 in Balatonfüred, (Ungarn) stattfindet, werde ich in einem meiner Paper auf diese Entwicklung eingehen:

Open-Source AI for Open User Innovation: Designing a Personal Fabrication Framework

Digital Sovereignty and Open-Source AI: The European Way for Innovative SMEs