Wenn es um Künstliche Intelligenz geht, lesen wir in letzter Zeit immer häufiger, dass für die großen KI-Modelle „unbedingt“ größere Rechenzentren benötigt werden. Dafür wurden auch schon hohe Milliarden-Beträge auf dem Kapitalmarkt eingesammelt. Es scheint hier kein Limit zu geben.

Andererseits stehen allerdings auch Fragen zu den dafür benötigten Ressourcen im Raum. In einer modernen Welt geht es nicht mehr alleine um die Bedürfnisse von Tech-Konzernen, sondern auch darum, eine lebenswerte Umwelt zu erhalten. In dem Zusammenhang geht es somit auch um den CO2-Verbauch und um den Bedarf an Wasser. Dazu findet man im Aktuellen AI Report folgendes:

„AI’s environmental footprint is expanding alongside its capabilities. Grok 4’s estimated training emissions reached 72,816 tons of CO2 equivalent. AI data center power capacity rose to 29.6 GW, comparable to New York state at peak demand, and annual GPT-4o inference water use alone may exceed the drinking water needs of 12 million people“ (AI Report 2026).

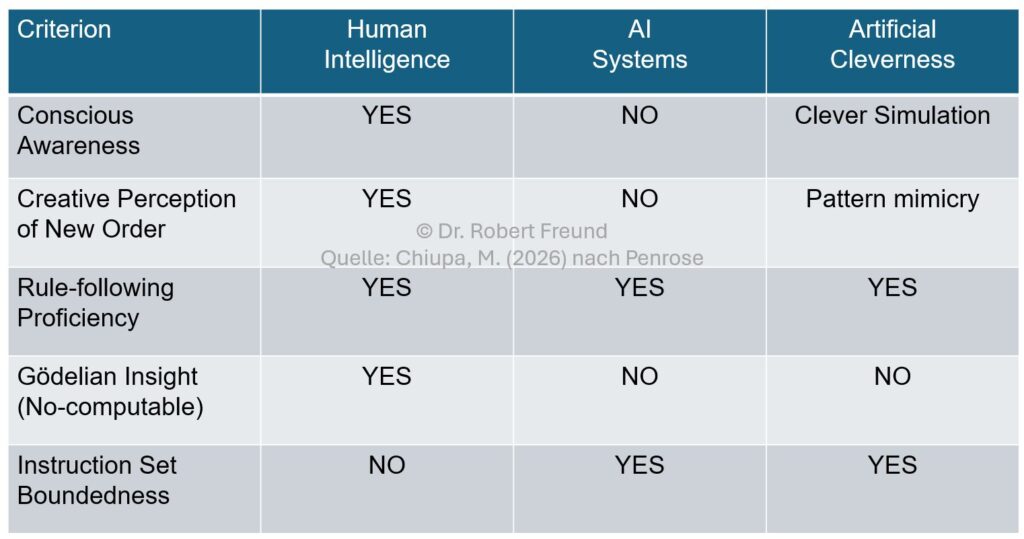

Es ist schon erstaunlich, welche Ressourcen die hier genannten KI-Modelle verschlingen. Dabei streben die großen KI-Systeme eine übergreifende Art von Intelligenz an: Artificial General Intelligence (AGI), die der menschlichen Intelligenz weit überlegen sein soll. Betrachten wir daher einmal, wie viel Energie ein Mensch für eine komplexe Problemlösung benötigt:

„Das menschliche Gehirn leistet vieles, was Maschinen überfordert – und das mit minimalem Energieverbrauch. Im Durchschnitt verbraucht es nur etwa 20 Watt, so viel wie eine schwache Glühbirne“ Knees (2025): Wie Forscher die Tech-Konzerne entmachten wollen, in Handelsblatt vom 11.10.2025.

„Unser Gehirn benötigt für hochkomplexe Informationsübertragungen und -verarbeitungen weniger Energie als eine 30-Watt-Glühbirne“ (Prof. Dr. Amunts).

Es wird deutlich, dass der Energieverbrauch der großen Tech-KI-Modelle weniger intelligent ist, als man es uns weismachen möchte. Es wundert daher nicht, dass die Entwicklung immer größerer Modelle (Large Language Models) infrage gestellt wird.

Forscher sind aktuell auf der Suche nach Modellen, die ganz anders aufgebaut sind und nur einen Bruchteil der aktuell benötigten Energie verbrauchen. Gerade in China gibt es dazu schon deutliche Entwicklungen. Auch in Deutschland befassen sich Forscher mit dem Thema neuroinspirierte Technologien.