Der Begriff „Cruel Optimism“ (Grausamer Optimismus) wurde von Lauren Berlant geprägt und ist in Berlant, L. (2011): Cruel optimism ausführlich erläutert. Was ist nach Berlant unter „Grausamer Optimismus“ zu verstehen?

„A relation of cruel optimism exists when something you desire is actually an obstacle to your flourishing“. (…) They become cruel only when the object that draws your attachment actively impedes the aim that brought you to it initially.

Nicht jede optimistische Wunschvorstellung ist per se grausam. Sie wird allerdings zu einem Grausamen Optimismus (Cruel Optimism), wenn das Objekt, an dem Ihre Zuneigung hängt, das Ziel, das Sie ursprünglich dazu geführt hat, aktiv behindert. Das ist nicht ganz leicht zu verstehen. Zwei Beispiele können möglicherweise helfen:

„Zwei hervorragende Beispiele dafür sind die Diätindustrie und die kulturelle Besessenheit von Produktivitätstricks: Anstatt unsere maroden Ernährungssysteme oder die schleichende Kultur von Burnout und Überarbeitung zu betrachten, schieben wir die Verantwortung für eine gesündere Ernährung und ein effizienteres Zeitmanagement auf den Einzelnen ab. Dadurch blenden wir die tieferliegenden Ursachen systemischer Probleme aus. Und wenn die Lösung dann scheitert, geben sich die Betroffenen selbst die Schuld, nicht genug Willenskraft gehabt zu haben“ (Goleman, D. (2026): How AI Could Produce ‘Cruel Optimism’, deutschsprachige Übersetzung mit Google Translate).

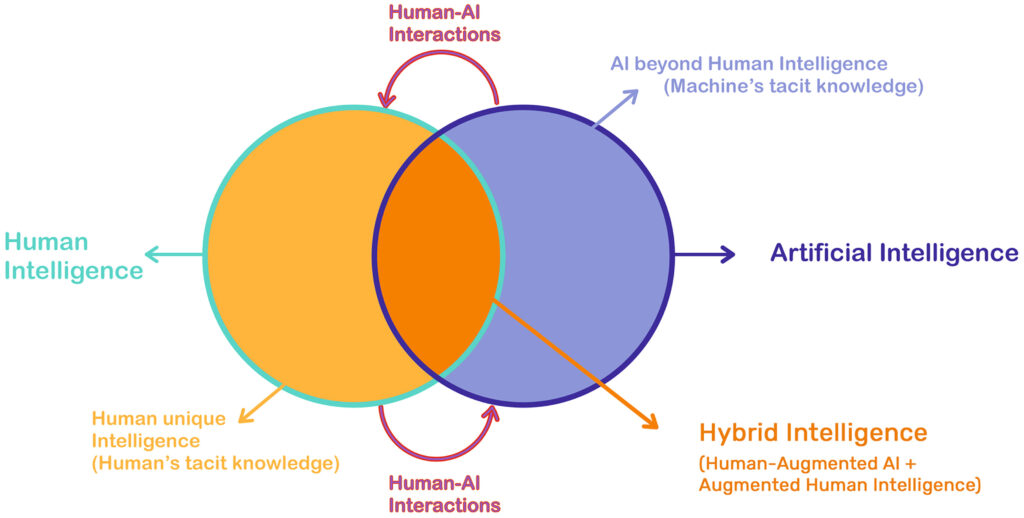

Goleman sieht hier auch einen Zusammenhang zwischen Künstlicher Intelligenz und dem von Berlant angesprochenen „Grausamen Optimismus“. Auch Künstliche Intelligenz weckt Wünsche und Sehnsüchte, und verheißt eine optimistische, effiziente Zukunft, da KI alle möglichen Probleme der Menschen lösen kann, bzw. lösen wird.

Wenn wir also mit den KI-Modellen und KI-Agenten die Probleme nicht lösen können, so sind wir Menschen eben die Dummen. Auch hier geben sich die einzelnen Personen, oder Gruppen von Personen, oder sogar Organisationen die Schuld, nicht gut genug zu sein in der Nutzung von Künstlicher Intelligenz. Diese Logik führt zwangsläufig zu einem „Grausamen Optimismus“ in der die Betroffenen sich selbst die Schuld geben. Der oben verlinkte Beitrag von Daniel Goleman enthält noch weitere (englischsprachige) Details dazu.

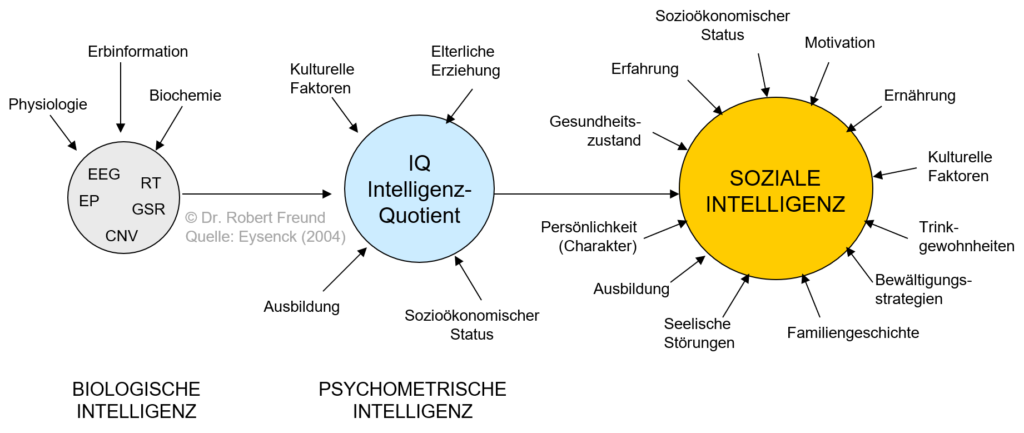

Interessant ist hier auch, dass Daniel Goleman 1995 den Bestseller Emotional Intelligence. Why it can matter more than IQ (Quelle: Wikipedia) geschrieben hat und Goleman sich in der Tradition von Howard Gardner´s Theorie der Multiplen Intelligenzen versteht.